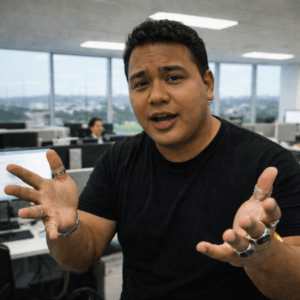

Matthieu Bridoux, dans le test depuis plus d’une décennie, combine une activité de testeur et une activité de formateur. Dans ce cadre, il a développé une plateforme d’entraînement à Playwright : Mission Playwright, qui propose désormais une large gamme d’exercices pratiques. Une initiative précieuse dans le monde du test francophone ! Matthieu a accepté de répondre à nos questions sur cette plateforme et sur sa pratique du test.

Les origines de Mission Playwright

Hightest : Qu’est-ce qui t’a donné envie de créer ces exercices Playwright en ligne ?

Matthieu Bridoux : Tout est parti d’un constat terrain : quand j’enseigne l’outil Playwright en formation, les apprenants manquent de terrain d’entraînement réaliste. Les exercices qu’on trouve en ligne sont souvent trop simples, trop statiques, ou pas du tout représentatifs de ce qu’on rencontre en mission. Je voulais un endroit où on puisse s’entraîner sur de vrais scénarios – des formulaires capricieux, des éléments dynamiques, des comportements asynchrones, bref, la vraie vie.

Il y a aussi un problème plus concret avec les sites d’entraînement existants : ils sont truffés de publicités. Et ce n’est pas qu’une question de confort visuel, ces pubs interfèrent directement avec les scripts d’automatisation. Un banner qui s’affiche au mauvais moment, une popup qui bloque l’interaction… et le test plante. Ce n’est pas ce qu’on veut faire vivre à quelqu’un qui apprend.

En parallèle, en tant que testeur en mission, je me retrouvais régulièrement dans une situation frustrante : je voulais tester rapidement une fonctionnalité précise de Playwright comme gérer un upload de fichier, simuler un drag and drop mais je n’avais pas d’application sous la main pour le faire.

Donc j’avais besoin d’un bac à sable fiable, propre et ciblé où je peux aller directement sur l’exercice qui m’intéresse, valider mon approche, et une fois que la solution fonctionne, la réutiliser sereinement sur l’application de mon client si besoin.

Hightest : Comment as-tu procédé ?

Matthieu Bridoux : Honnêtement, j’aurais pu passer des semaines à construire ça de zéro. Mais j’ai fait un choix pragmatique : j’ai utilisé Lovable, un outil de génération d’interfaces par IA.

Ce qui m’a convaincu, c’est sa rapidité. En décrivant les comportements que je voulais, un champ qui apparaît sous condition, un tableau paginé, une modale avec délai, je pouvais avoir un composant fonctionnel en quelques minutes. Pour quelqu’un qui pense en cas de test plutôt qu’en composants React, c’est un game changer.

Mon workflow était simple : je réfléchissais d’abord au type de difficulté que je voulais entraîner chez l’automaticien, je le décrivais à Lovable, j’ajustais, et je passais à l’exercice suivant. La valeur que j’apporte, c’est la pédagogie et l’expertise métier, pas la technique.

Ce projet m’a aussi confirmé quelque chose : l’IA ne remplace pas le testeur, elle lui enlève les frictions pour qu’il se concentre sur ce qui compte vraiment.

Témoignage d’un apprentissage

Hightest : Peux-tu nous parler d’une mission qui t’a particulièrement marqué dans ton parcours de testeur ?

Matthieu Bridoux : La mission qui me vient immédiatement, c’est celle où j’ai mis les mains dans Playwright pour la toute première fois.

J’arrivais avec une vraie expérience en automatisation, mais plutôt sur des outils no-code notamment Cerberus. Donc j’avais les réflexes du testeur automaticien, la logique de couverture, la rigueur sur les parcours critiques… mais pas le code. Passer à Playwright, c’était changer de registre.

Ce qui est intéressant, c’est que je me suis formé en autonomie. Pas de formation officielle, pas de mentor désigné. Je me suis appuyé sur la doc, sur mes expérimentations, et surtout sur la communauté QA interne de mon client. Ces échanges informels avec d’autres automaticiens ont été précieux. C’est souvent là qu’on débloque les vrais problèmes, ceux que la doc ne couvre pas.

Au bout de trois mois, je me sentais vraiment à l’aise. Ce qui m’a confirmé ce sentiment, ce n’est pas tant d’avoir tout compris, c’est d’avoir développé le réflexe de débloquer rapidement. Dès qu’un problème surgissait, je savais où chercher, comment isoler, comment résoudre.

Et concrètement, les résultats étaient là :

- Mes parcours critiques automatisés

- Intégrés dans une CI/CD

- Avec un rapport automatisé dans XRAY

- Et des notifications Slack en temps réel

Cette mission m’a appris que la courbe d’apprentissage sur Playwright est raide au début, mais qu’elle s’aplatit vite si on est entouré et qu’on pratique vraiment. C’est d’ailleurs une des convictions qui m’a poussé à créer mon accompagnement sur Playwright.

L’IA dans tout ça ?

Hightest : Quelle est l’utilisation que tu fais de l’IA aujourd’hui, dans le cadre de tes missions de test, mais aussi dans ton quotidien de formateur ?

Matthieu Bridoux : Mon usage de l’IA est pragmatique et ancré dans le quotidien. Je l’utilise quand elle me fait vraiment gagner du temps.

En mission, je travaille actuellement sur des tests d’application mobile avec Appium. Et mon réflexe dès qu’une erreur apparaît en console, c’est de la soumettre directement à Claude IA. Plutôt que de passer de longues minutes à éplucher la doc ou chercher sur Stack Overflow, j’obtiens une explication contextualisée et des pistes de correction rapidement. L’important pour moi, c’est de comprendre pourquoi ça plante, pas juste corriger en aveugle.

Côté Playwright, j’ai réalisé un POC autour des agents IA où plusieurs agents collaborent : l’un rédige les cas de test, un autre génère les scripts, un autre les corrige. C’est encore expérimental, mais les résultats sont prometteurs. La vraie question maintenant c’est de valider ça sur un projet concret avec toute sa complexité. J’ai aussi Claude Code dans ma liste de choses à tester prochainement, ça m’intéresse particulièrement pour voir ce que ça donne sur des projets d’automatisation bout en bout.

Au quotidien dans mon éditeur, j’utilise GitHub Copilot sur VS Code. L’autocomplétion change vraiment le rythme d’écriture, on code plus vite, et ça réduit la charge mentale sur les parties répétitives.

Ce que je retiens de tout ça : l’IA est un accélérateur. L’expertise du testeur reste indispensable pour poser les bonnes questions et valider ce qui est produit.

Prise de hauteur

Hightest : Comment dirais-tu que le monde du test a évolué depuis que as débuté ta carrière ?

Matthieu Bridoux : Avec 12 ans dans le métier, j’ai une perspective assez large sur ce chemin parcouru et honnêtement, l’évolution est massive.

Quand j’ai commencé, mon quotidien c’était HP ALM : on rédigeait des cas de test, on les exécutait manuellement, on remontait les anomalies. C’était rigoureux, structuré, mais lent. Et surtout, l’automatisation était encore un sujet de niche, on en parlait peu et peu d’équipes la pratiquaient vraiment, et la CI/CD c’était presque de la science-fiction pour la plupart des projets.

Aujourd’hui, c’est un autre monde. L’automatisation est devenue une attente de base sur la plupart des missions. La CI/CD est partout. Les testeurs doivent comprendre les pipelines, savoir intégrer leurs tests dans un workflow DevOps, lire du code. Le profil du testeur a profondément changé — on est passé d’un métier de vérification à un métier de qualité intégrée dans le delivery.

Et maintenant on voit arriver l’IA par-dessus tout ça. Une nouvelle couche de transformation qui s’accélère encore.

Ce qui me frappe le plus, c’est que le fond du métier reste le même — comprendre le risque, protéger l’utilisateur, poser les bonnes questions. Mais les outils et les compétences attendues ont été complètement redéfinis. C’est ce qui rend ce métier stimulant : il ne se fige jamais.

____________________

Merci à Matthieu Bridoux d’avoir répondu à nos questions ! Si vous souhaitez vous entraîner, rendez-vous donc sur Mission Playwright.

Elle comporte plusieurs liens qui permettent de retrouver facilement certaines notions, et permettent aussi en un clic de retrouver tous les autres articles scientifiques sur la qualité logicielle qui ont été enregistrés dans cette instance Obsidian.

Elle comporte plusieurs liens qui permettent de retrouver facilement certaines notions, et permettent aussi en un clic de retrouver tous les autres articles scientifiques sur la qualité logicielle qui ont été enregistrés dans cette instance Obsidian.